Pentagon klassar Anthropic som säkerhetsrisk efter AI-konflikt

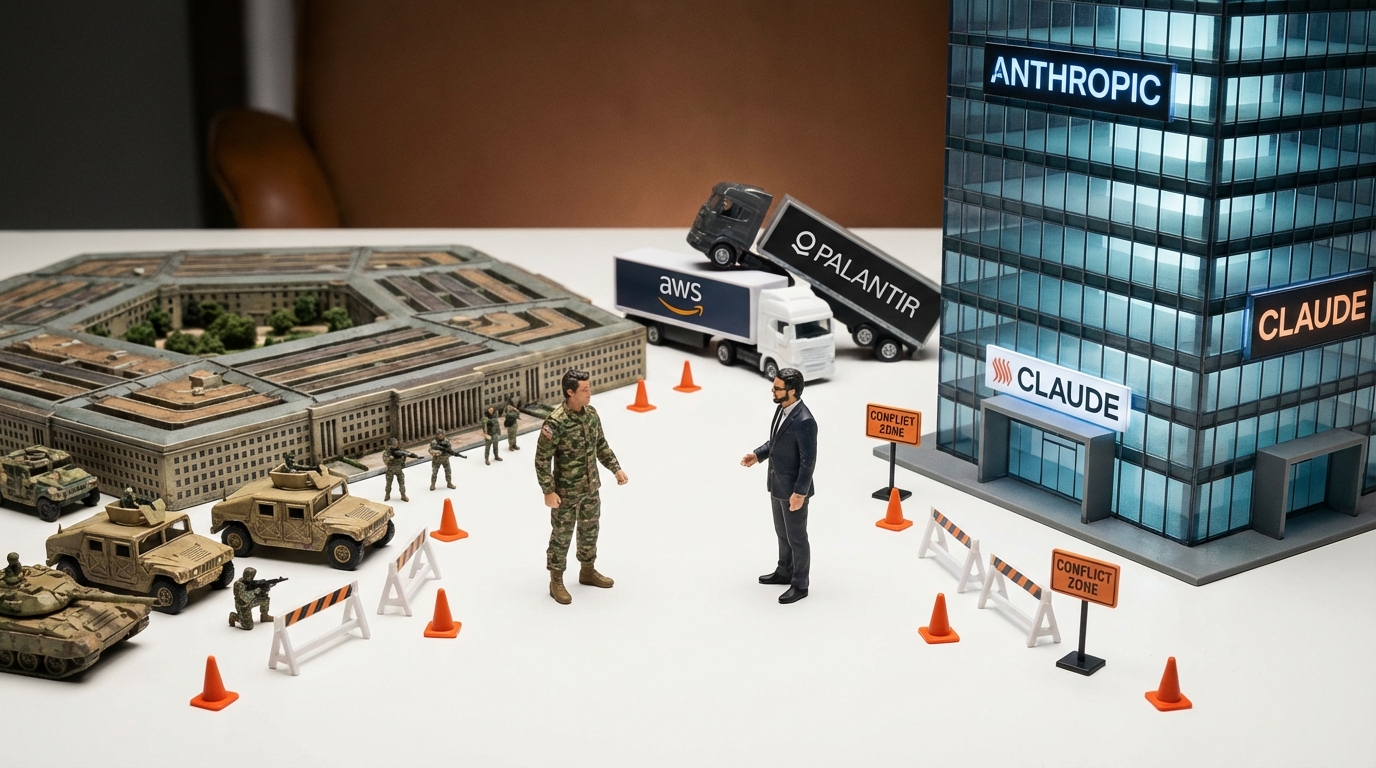

Det blev snabbt mycket värre för AI-företaget Anthropic efter att de sade nej till Pentagons krav. Först beordrade Trump alla federala myndigheter att sluta använda deras Claude AI-tjänster. Bara två timmar senare gick försvarsminister Pete Hegseth ett steg längre och klassificerade hela företaget som en "leveranskedjerisk".

Konflikten handlar om ett kontrakt där Pentagon ville ha "all laglig användning" av Anthropics AI-teknik. Det skulle innebära att militären kunde använda tekniken för massövervakning av amerikanska medborgare och utveckla autonoma dödliga vapen. Anthropics VD Dario Amodei vägrade att ta bort säkerhetsbromsar från deras AI-system för sådana ändamål.

Beslutet får direkta konsekvenser för stora teknikföretag som Palantir och AWS, som använder Claude-modellen i sitt arbete för Pentagon. Medan Anthropic står fast vid sina etiska principer har konkurrenter som OpenAI och xAI redan accepterat Pentagons villkor.

Anthropics vägran att böja sig för militärens krav sätter företaget i en prekär situation. Pentagon hotar med att märka dem som säkerhetsrisk, vilket skulle kunna kosta dem kontrakt värda hundratals miljarder dollar. Samtidigt väcker konflikten frågor inom teknikbranschen om vilken framtid de bygger när AI-företag tvingas välja mellan etik och ekonomi.

Anthropic säger att de är villiga att utmana beslutet i domstol, men det återstår att se hur långt företaget är beredd att gå för att behålla kontrollen över hur deras AI-teknik används.